Un equipo de investigadores de la Universidad de Texas en El Paso (UTEP) realizó un estudio del habla que podría ayudar a que las voces generadas por Inteligencia Artificial (IA) suenen más naturales y confiables. Los expertos centraron su atención en un fenómeno llamado reducción fonética —cuando las personas articulan menos ciertos sonidos al hablar— algo que hasta ahora pasa desapercibido para los sistemas de voz artificiales.

El hallazgo clave, según el estudio, es que las personas tienden a pronunciar de forma más relajada cuando expresan emociones positivas, y este patrón también se observa tanto en inglés como en español. Este tipo de variación podría ser la clave para que las voces de IA dejen de sonar rígidas o “frías” y resulten más dinámicas al interactuar con seres humanos.

¿Cómo realizaron el estudio los investigadores?

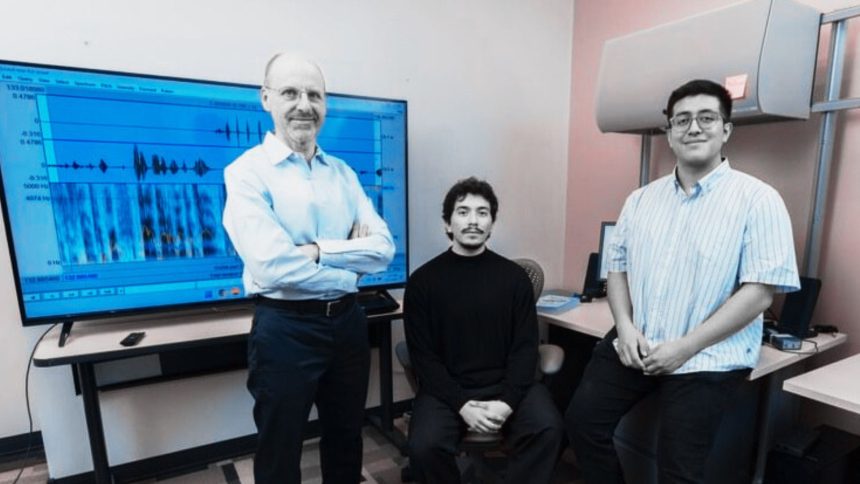

Los científicos del Departamento de Ciencias de la Computación de UTEP, encabezados por el Dr. Nigel Ward, grabaron a hablantes de inglés y español pronunciando una serie de frases dos veces: una con tono neutro y otra con tono positivo. Posteriormente, jueces independientes evaluaron cada sonido (fonema) para detectar diferencias en la articulación.

Los resultados mostraron que en el habla positiva hay una mayor proporción de reducción fonética: en inglés, alrededor de 30% de los sonidos se consideraron reducidos y 9% altamente reducidos, mientras que en español las cifras rondaron 35% y 4%, respectivamente.

Implicaciones para la inteligencia artificial

Tradicionalmente, los sistemas de voz de IA buscan maximizar la inteligibilidad, lo que significa que pronuncian cada palabra con precisión extrema. Sin embargo, esta claridad total puede hacer que las voces suenen artificiales y carentes de emoción.

Los investigadores de UTEP proponen que si los modelos de IA incorporan elementos como la reducción fonética en contextos adecuados, las voces sintéticas podrían resultar menos robóticas y más parecidas a la comunicación humana real. Esto no solo mejoraría la percepción de los usuarios, sino también la utilidad de las interfaces conversacionales en aplicaciones cotidianas como asistentes personales o traducción de voz en tiempo real.

¿Hacia dónde va esta investigación?

Además de describir sus hallazgos en la revista Speech Communication, el equipo planea compartir más sobre la aplicación práctica de sus resultados y participar en conferencias especializadas. Ya utilizan herramientas como ReduEst, un programa desarrollado por estudiantes para medir el grado de reducción fonética en grabaciones de voz.

Los investigadores esperan que otros equipos amplíen estos estudios a más idiomas y contextos, con el fin de enriquecer la forma en que la IA comprende y reproduce el habla humana.